Zicheng

Zicheng- 关注

0

1

2

3

4

5

6

7

8

9

0

1

2

3

4

5

6

7

8

9

0

1

2

3

4

5

6

7

8

9

罗德岛大学的研究人员在一篇论文中提出了一种新颖的后门攻击方法,利用白高斯噪声的功率谱密度作为触发器,不仅提高了攻击的可行性和普遍性,在模型中都取得了很高的平均攻击成功率,而且不会对非受害者造成显著干扰。

据Cyber Security News消息,研究人员提出了一种噪声攻击(NoiseAttack) 的新型后门攻击方法,该攻击被称为是一种用于图像分类的后门攻击,针对流行的网络架构和数据集实现了很高的攻击成功率,并能绕过最先进的后门检测方法。

实验结果表明,该攻击能有效对抗最先进的防御系统,并在各种数据集和模型上实现较高的攻击成功率。它利用白高斯噪声(White Gaussian Noise)作为触发器,创建了一种针对特定样本的多目标后门攻击,可灵活控制目标标签。

与通常针对单一类别的现有方法不同,该攻击使用具有不同功率谱密度的白高斯噪声作为触发器,并采用独特的训练策略来执行攻击,因此只需最少的输入配置就能针对多个类别进行攻击。

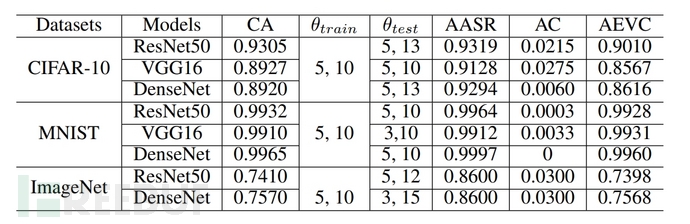

不同数据集和模型的攻击性能

不同数据集和模型的攻击性能

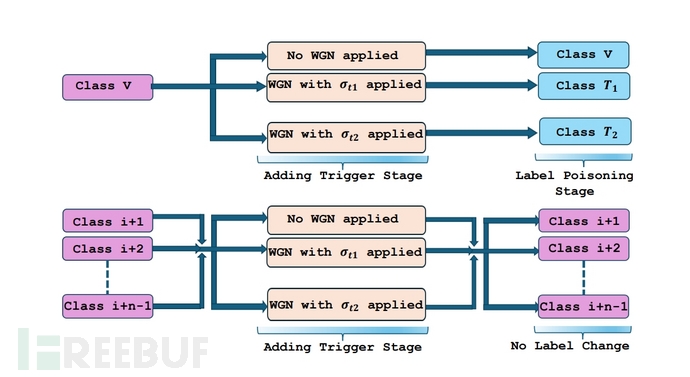

这种噪声攻击在研究中被称为是一种用于图像分类的新型后门攻击 ,利用白高斯噪声(WGN)的功率谱密度(PSD)作为训练过程中嵌入的触发器。这种攻击涉及在精心制作的噪声水平和相关目标标签构建的中毒数据集上训练一个后门模型,从而确保模型容易受到触发,导致所需的误分类。

NoiseAttack 后门训练准备的中毒数据集概览

NoiseAttack 后门训练准备的中毒数据集概览

这种攻击为创建具有多个目标标签的后门提供了一种通用方法,从而为试图破坏机器学习模型的攻击者提供了一种强大的工具。

该框架能有效规避最先进的防御措施,并在各种数据集和模型中实现较高的攻击成功率。 通过在输入图像中引入白高斯噪声,该攻击可以成功地将图像错误分类为目标标签,而不会明显影响模型在干净数据上的性能。这种攻击对 GradCam、Neural Cleanse 和 STRIP 等防御机制的较强鲁棒性表明,它有可能对深度神经网络的安全性构成重大威胁。 此外,该攻击执行多目标攻击的能力也证明了它的多功能性和对不同场景的适应性。

参考来源

Noise Attack: A New Backdoor Exploiting Power Spectral Density for Evasion

如需授权、对文章有疑问或需删除稿件,请联系 FreeBuf 客服小蜜蜂(微信:freebee1024)