近年来,越来越多的深度造假(deepfake)攻击正在显著重塑组织、金融机构、名人、政治人物甚至普通人的威胁格局。与此同时,deepfake的使用也将商业电子邮件泄露(BEC)和身份验证绕过等攻击提升到了新的水平。

这些攻击成功的前提和原因包括:

- 所有的技术支柱都已到位。Deepfake生成的源代码是公开的,任何人都可以使用。

- 公开的图片数量足以让恶意行为者利用deepfake技术制造出数百万个假身份。

- 犯罪集团是此类技术的早期采用者,并定期研究使用deepfake技术来提高现有洗钱和货币化计划的有效性。

- 研究发现deepfake在新的攻击场景中实现的趋势,比如在社会工程攻击中,deepfake是一个关键的技术驱动器。

接下来,让我们来看看近年来这一新兴趋势是如何发展和演变的。

Deepfake促销骗局中的被盗身份

在新闻和社交媒体网站上,名人的图片被用于可疑的搜索引擎优化(SEO)活动已经是司空见惯的事情。通常,这些广告在某种程度上与所选名人的专业度有关,它们是专门被设计用来引诱用户,让他们选择图片下的链接。

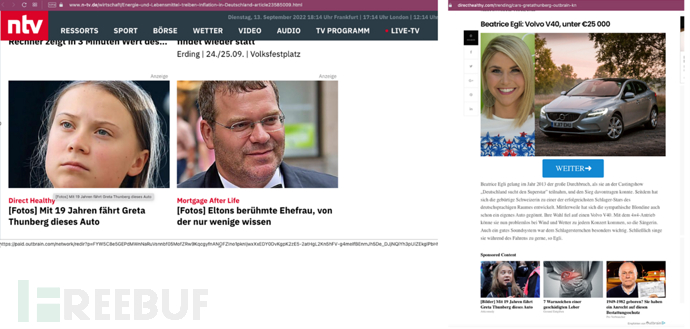

例如,图1显示了2022年9月13日德国新闻网站N-TV广告的截图。我们看到,广告的主角是知名人士,他们可能并不知道自己的图像正在被滥用。如果用户选择了这些广告,就会出现一个汽车广告页面(如图右侧所示)。选择类似的广告会转到另一个促销页面(见图2)。

图1:N-TV页面上的广告截图(左),以及用户选择该广告时出现的汽车广告(右)

图2:用户选择类似广告后打开的促销页面

多年来,不择手段的广告服务商一直在不同的盈利计划中使用这类媒体内容。然而,最近我们看到了这些广告的有趣发展,以及支持这些活动的技术变化。

最近,一些数字媒体和SEO货币化组织一直在使用公开分享的媒体内容来创建名人的deepfake模型。这些组织在未经名人和有影响力者同意的情况下就使用他们的形象,将deepfake的内容分发给不同的宣传活动。

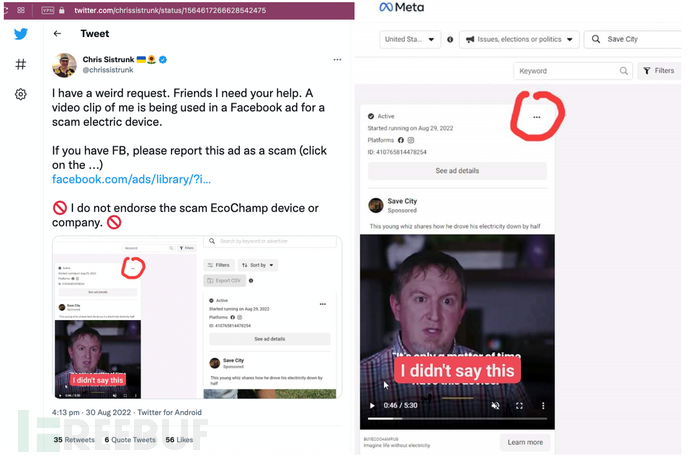

图3就突出显示了这样一个示例。Meta网站上出现了网络安全专家克里斯·西斯特伦克(Chris Sistrunk)的宣传活动。但值得注意的是,他既不是广告中出现的产品的代言人,也没有说广告视频中的任何内容。

图3:Meta广告活动中出现的网络安全专家Chris Sistrunk的deepfake视频

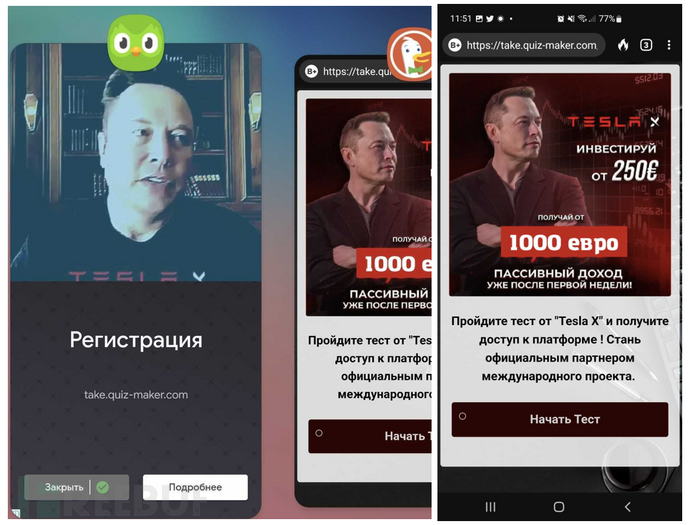

除了新闻和社交媒体网站外,在合法和流行的移动应用程序中也存在类似的广告,这些广告不仅会使用静态图像,甚至还使用埃隆·马斯克(Elon Musk)的deepfake视频来宣传“金融投资机会”。

图4:Duolingo广告中Elon Musk的deepfake视频;当用户选择广告时,它会引导他们进入一个页面,翻译过来是“投资机会;投资250欧元,收益1000欧元。”

Deepfake的下一个升级是能够在冒充名人的同时进行视频通话。

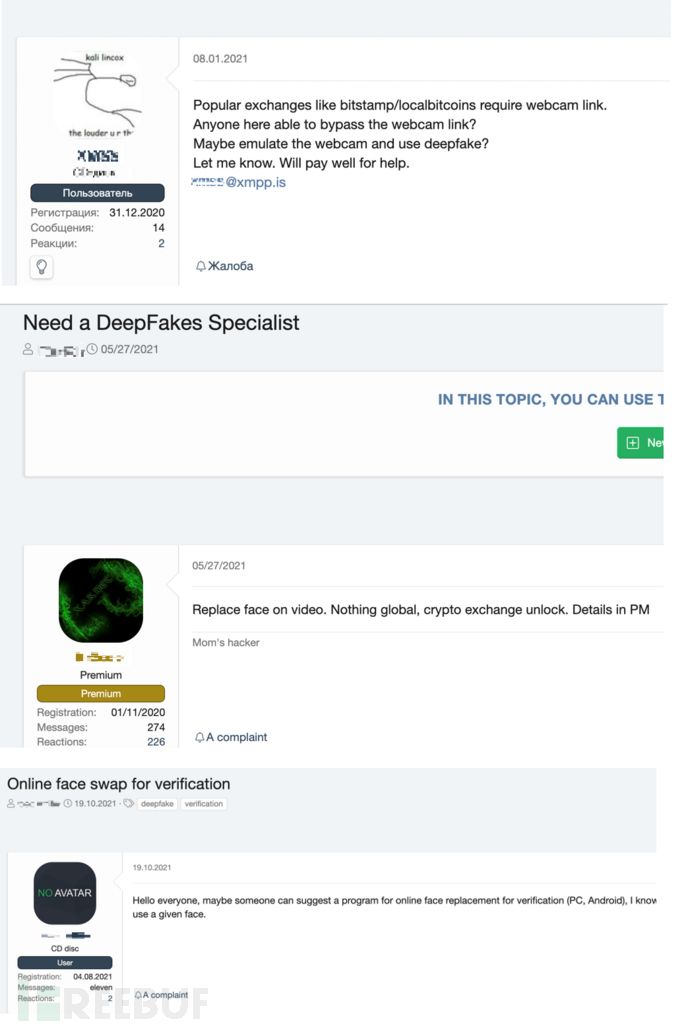

Deepfake服务的话题在地下论坛上相当流行。在这些讨论组中,我们看到许多用户都将网上银行和数字金融验证作为目标。对这些服务感兴趣的犯罪分子很可能已经拥有了受害者身份文件的副本,但他们还需要受害者的视频流来窃取或创建账户。这些账户日后可能被用于洗钱或非法金融交易等恶意活动。

地下市场的deepfake

使用验证工具和技术的地下犯罪攻击经历了显著的演变。例如,我们看到帐户验证服务已经存在很长一段时间了。然而,随着电子商务的发展,并且使用现代技术和在线聊天系统进行身份验证,犯罪分子也在发展他们的技术,并开发了绕过这些验证方案的新方法。

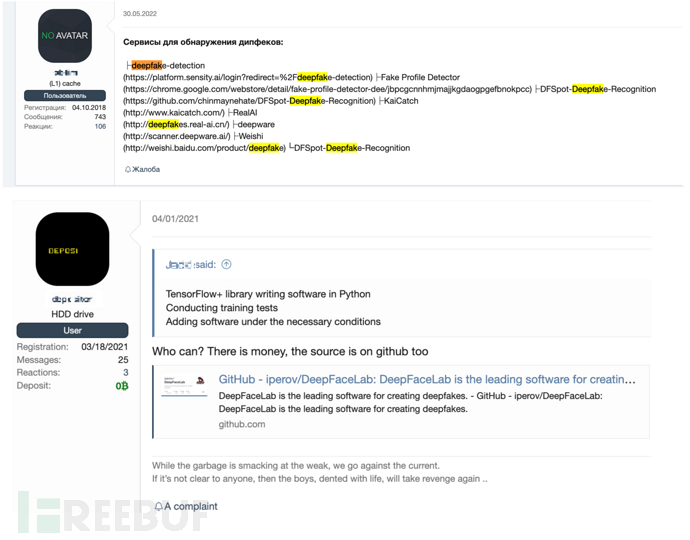

在2020年和2021年初,我们已经看到一些地下论坛用户正在寻找“deepfake专家”来进行加密货币和个人账户交易。

图5:地下论坛用户正在寻找deepfake专家来帮助他们进行视频人脸交换

事实上,一些用于deepfake制作的工具已经在网上提供了一段时间了,比如在GitHub上。我们还看到,用于deepfake和deepfake检测的工具在地下论坛上也引起了人们的关注。

图6:deepfake和deepfake检测工具

最近,一篇关于加密货币交易网站币安(Binance)一名通信高管的deepfake新闻报道被发布。该虚假新闻被用来欺骗Zoom电话中的加密货币项目代表。

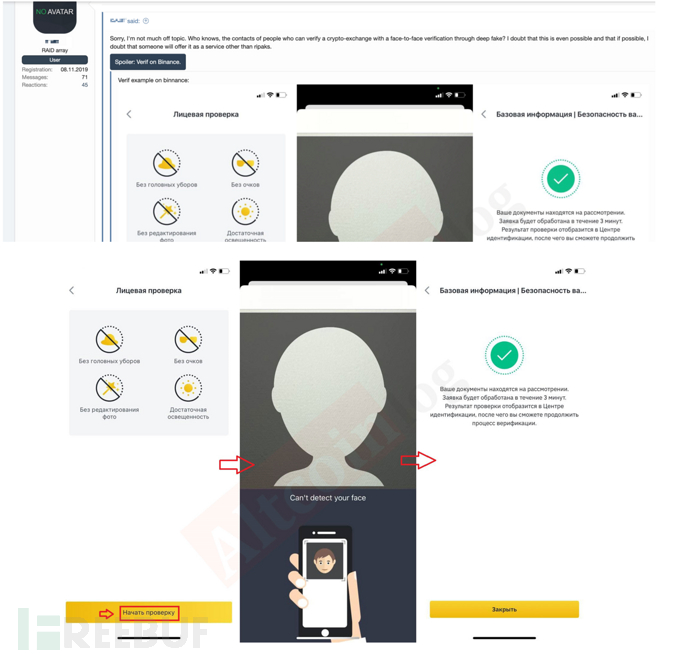

如图7所示,其中显示了来自图6中同一个地下线程的对话,讨论了如何使用deepfake绕过币安验证。自2021年以来,用户一直在试图找到破解币安面对面识别的方法。

图7:来自一个地下论坛的图片,讨论deepfake和币安身份验证过程

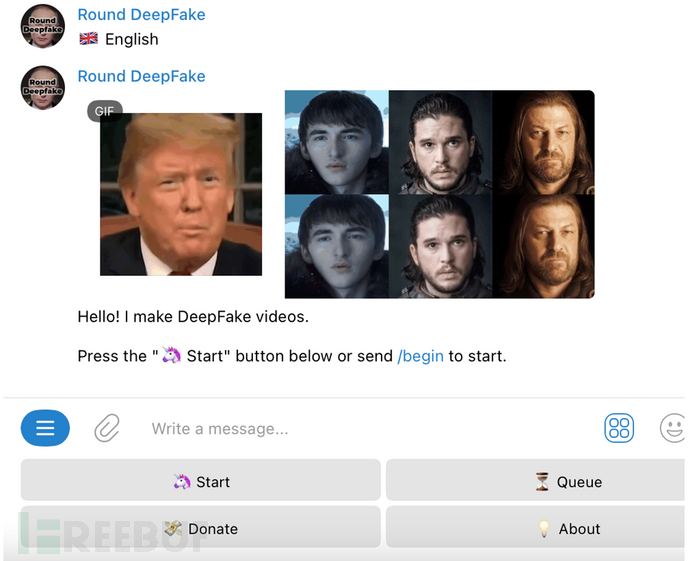

在工具方面,也有易于使用的机器人,使创建deepfake视频的过程变得更加容易。一个例子是Telegram机器人RoundDFbot。

图8:Telegram机器人制作deepfake视频

这些deepfake视频已经被用来给公众人物制造麻烦。名人、高级政府官员、知名企业人物以及其他在网上有许多高分辨率图像和视频的人最容易成为攻击目标。我们看到,利用他们的面孔和声音的社会工程骗局已经激增。

考虑到这些工具和现有的deepfake技术,我们可以预计会看到更多旨在通过伪造语音和视频操纵受害者的攻击和骗局。

Deepfake如何影响现有的攻击、骗局和盈利计划

犯罪分子可以利用deepfake来进行当前的恶意活动,我们已经看到了第一波此类攻击。下面列出了现有的攻击和我们在不久的将来可能会遇到的攻击:

- Messenger骗局:多年来,冒充理财经理打电话询问转账事宜一直是一种流行的骗局,现在犯罪分子可以在视频通话中使用deepfake技术。例如,他们可以冒充某人,联系他们的朋友和家人,要求转账或简单地为手机余额充值。

- BEC:即使没有deepfake,这种攻击也已经相当成功。现在,攻击者可以在电话中使用虚假视频,冒充高管或商业伙伴,并要求转账。

- 开户:犯罪分子可以利用deepfakes绕过身份验证服务,在银行和金融机构,甚至是政府机构,用偷来的身份文件副本,代他人创建账户。这些犯罪分子可以利用受害者的身份,绕过通常通过视频通话完成的验证过程。这些账户以后可能被用于洗钱和其他恶意活动。

- 劫持账户:犯罪分子可以通过视频通话控制需要识别身份的账户。他们可以劫持一个金融账户,然后简单地提取或转移资金。一些金融机构要求在线视频验证在网上银行应用程序中启用某些功能。显然,这种验证也可能成为deepfake攻击的目标。勒索:利用deepfake视频,恶意行为者可以制造更强大的勒索和其他与勒索相关的攻击。他们甚至可以植入利用deepfake技术制造的假证据。

- 虚假情报活动:Deepfake视频还可以制造更有效的虚假信息活动,并可用于操纵公众舆论。某些攻击,如拉高出货(pump-and-dump)计划,依赖于来自知名人士的消息。现在,这些信息可以使用deepfake技术来创建。这些计划肯定会产生财务、政治甚至声誉方面的影响。

- 技术支持诈骗:Deepfake行为者可以使用假身份对毫无戒心的用户进行社交工程,让他们分享支付凭证或获取IT资产。

- 社会工程攻击:恶意行为者可以使用deepfake来操纵被模仿者的朋友、家人或同事。

- 劫持物联网(IoT)设备:使用语音或人脸识别的设备,如亚马逊的Alexa和许多其他智能手机品牌,将会出现在deepfake罪犯的目标名单上。

安全建议

我们已经看到了第一波使用deepfake的犯罪和恶意活动。但是,由于以下问题,未来很可能会出现更严重的攻击:

- 社交媒体上曝光的内容足以为数百万人创造deepfake模型。每个国家、城市、村庄或特定社会群体的人都将自己的社交媒体暴露在世界面前。

- 所有的技术支柱都已到位。攻击实施不需要大量投资,攻击不仅可以由国家和公司发起,也可以由个人和小型犯罪组织发起。

- 威胁行为者已经可以模仿和窃取政客、C级高管和名人的身份。这可以显著提高某些攻击的成功率,如金融计划、短期虚假信息宣传、公众舆论操纵和敲诈勒索。

- 普通人的身份可以从公开曝光的媒体中被窃取或重塑。网络犯罪分子可以从被冒充的受害者那里窃取信息,或者利用他们的身份进行恶意活动。

- Deepfake模型的修改可能会导致从未存在过的人的身份大量涌现。这些身份可用于不同的欺诈计划。这种迹象已经在野被发现。

那么,个人和组织可以做些什么来应对和减轻deepfake攻击的影响?对于普通用户,以及使用生物特征模式进行验证和身份验证的组织,我们有一些建议。其中一些验证方法也可以自动化并广泛部署。

- 多因素身份验证方法应该是敏感或关键帐户的任何身份验证的标准方法。

- 组织应该通过三个基本因素对用户进行身份验证:用户拥有的东西,用户知道的东西,以及用户的身份。

- 通过相关样本进行人员意识培训,以及KYC(know-your- customer)原则对金融机构来说是必要的。Deepfake技术并不完美,组织的员工应该注意某些危险信号。

- 社交媒体用户应尽量减少高质量的个人形象曝光。

- 在验证敏感账户(例如银行或公司档案)时,用户应优先使用较少暴露于公众的生物特征识别模式,如虹膜和指纹。

- 要在更大范围内解决这一问题,就需要重大的政策改变。这些政策应解决当前和以前暴露的生物识别数据的使用问题。他们还必须考虑到目前网络犯罪活动的状况,并为未来做好准备。

原文链接: