CDra90n

CDra90n- 关注

0

1

2

3

4

5

6

7

8

9

0

1

2

3

4

5

6

7

8

9

0

1

2

3

4

5

6

7

8

9

0

1

2

3

4

5

6

7

8

9

0

1

2

3

4

5

6

7

8

9

0

1

2

3

4

5

6

7

8

9

协同感知系统通过整合来自外部资源的数据,极大增强了连接和自动驾驶车辆(CAVs)的感知能力,但也带来了潜在的安全风险。由于CAV的驾驶决策依赖于远程不受信任的数据,因此它们容易受到协同感知系统中恶意参与者发动的攻击影响。然而,对于这些威胁的安全分析和对策尚未充分。本研究发现了多种实时数据伪造攻击,攻击者通过向攻击目标传递精心制作的恶意数据,以扰乱其感知结果,从而导致紧急制动或增加碰撞风险。

0x01 简介

自动驾驶车辆(CAVs)的感知系统对安全至关重要,因为其性能直接影响驾驶决策。然而,CAV的感知面临一个基本限制,即车载传感器的感知能力有限。例如,常用的3D传感器LiDAR无法穿透遮挡物,可能产生低分辨率,导致检测性能不完善。最近的许多研究提出了基于LiDAR的协同感知算法,其中不同的附近车辆交换感知信息(例如原始传感器数据或经神经网络处理的特征图),并对融合的数据使用目标检测算法。

尽管协同感知正在迅速发展,但它给车辆安全引入了严重的漏洞,因为安全关键的感知算法现在依赖于来自远程不受信任车辆的传感器数据或特征图。通过对远程车辆进行物理访问,攻击者可以控制该车辆的软件或硬件,伪造分享的数据,将虚假的目标检测结果注入到目标车辆中,误导它们触发事故。

这项研究中提出了针对性攻击,可以在目标的感知结果中欺骗或移除指定位置的物体,使所有主流类型的协同感知方案都变得脆弱。对于早期融合系统(直接合并LiDAR点云),本文提出了黑盒射线投射来重构恶意但自然的原始点云,并设计了离线对抗性物体生成和运行时遮挡感知点采样,以进一步优化修改点的分布。对于中期融合系统(将特征图作为目标检测模型的中间结果进行合并),本文设计了一种白盒对抗性攻击来扰乱特征图。为了实现最佳效率,对抗性攻击通过黑盒方法初始化扰动向量,并在每个LiDAR周期(例如,100毫秒)中运行反向传播。本文还提出了零延迟攻击调度,通过这种方式,攻击者在不引入显著延迟的情况下获得了一个LiDAR周期的时间来完成攻击生成。

0x02 背景

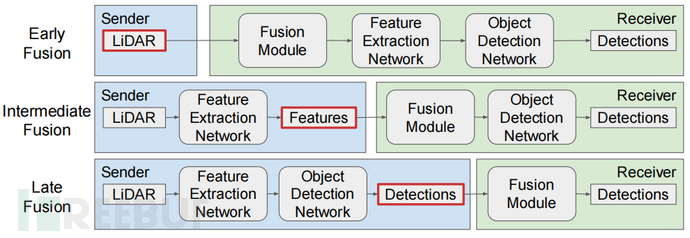

CAVs是复杂的网络物理系统,配备有LiDAR、摄像头和雷达等传感器以感知周围环境,并通过软件做出适当的驾驶决策。截至2022年底,包括Waymo、本田、百度和特斯拉在内的众多公司已经开发出多个CAV模型。协同感知用于增强CAV感知,通过在基础设施或车辆之间共享原始或经过处理的传感器数据。主流解决方案侧重于LiDAR传感器,因为LiDAR图像带来了丰富的3D几何特征。根据数据共享的方式,协同感知有三种主要类型,如下图所示。早期融合的CAVs直接交换原始传感器数据,其格式通常是通用的,但需要付出数据传输带宽的代价;中期融合的方案要求CAVs传输特征图,即感知算法的中间产物,提供了网络效率和感知精度之间的良好平衡;在晚期融合方案中会共享轻量级的感知结果,如目标边界框。

2017年,3GPP标准化了C-V2X技术,标志着路边通信的成熟。从那时起,华为、英特尔、博世、英飞凌和高通等主要技术公司一直在努力构建各种C-V2X解决方案。在德国、法国、美国和日本等国家,已经启动了全球范围内的道路试验。福特和百度Apollo建立了真实世界的协同感知数据集。有几种攻击可能危害LiDAR感知系统。首先,CAVs上的LiDAR容易受到物理攻击的影响,例如GPS欺骗、LiDAR欺骗和物理可实现的对抗攻击,这些攻击针对单一自动驾驶车辆。对于晚期融合,由于协同感知共享对象位置,因此攻击者可以轻松修改这些位置。针对中期融合协同感知,通过扰乱中期融合系统中的特征图,可能创建不准确的检测边界框。

CAV感知防御:现有的防御机制并未针对本文提出的攻击进行设计,因此无法有效解决这些攻击。几个V2X通信标准定义了网络协议的安全实践(例如,访问控制、消息完整性)。然而,它们无法阻止数据伪造攻击,因为攻击者可以在将数据包装到协议消息之前修改数据,而这些消息在此之前是受到保护的。受信任执行环境(TEEs)通过安全硬件可能可以保护感知算法,但由于其部署困难且容易受到侧信道攻击的影响,其有效性存在挑战。

0x03 数据伪造

A. 公式化

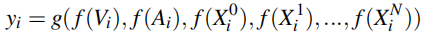

在一个场景中,多辆车共同执行协同感知,攻击者的目标是欺骗或移除攻击目标感知结果中指定位置的道路对象(例如车辆、行人)。将数据伪造问题定义为一个优化问题,用Ai、Vi和Xi(j),其中j ∈ {0,1,...N}表示攻击者、攻击目标和其他良性车辆在帧i ∈ N时的LiDAR数据。具有相同帧索引的LiDAR数据将在攻击目标端合并以生成感知结果。将数据共享前的预处理表示为f,数据共享后的后处理表示为g。对于攻击目标在帧i上的正常协同感知,可以描述为:

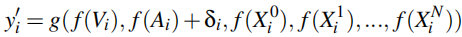

攻击者可以用恶意数据替换f(Ai)。 例如,攻击者可以附加一个微小的扰动 δi 来制作恶意数据为 f(Ai) +δi ,这会将原始感知结果从 yi 更改为 y′i :

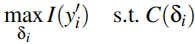

给定一个评估攻击成功的适应度函数 I 和限制扰动的攻击约束 C,攻击者得到了:

B. 威胁模型

假设在V2V场景中执行协同感知的情况下,CAV会在这个场景中执行协同感知。通过将一个或多个车辆替换为边缘计算设备,可以轻松推广到车辆对基础设施(V2I)设置。假设攻击者可以物理控制至少一辆参与协同感知的车辆,使攻击者能够在车辆的软硬件上获得特权,从而操纵传感器、篡改本地算法执行并通过网络发送任意数据。换句话说,攻击者可以直接更改要共享的数据,即早期、中期和晚期融合感知方案中的LiDAR点云、特征图和边界框。

攻击专注于早期融合和中期融合的协同方案,因为攻击者需要巧妙地制作复杂的结构化数据。在感知模型方面,由于攻击者在本地安装感知模型以加入协同感知,假设他们具有白盒访问权限(即模型参数)。本文提出的一些攻击不需要模型访问或仅需要推理API。

同时,假设存在攻击者无法侵入的良性车辆,且无法控制在繁忙道路上环绕目标车辆的所有车辆。不考虑诸如LiDAR欺骗和GPS欺骗等物理传感器攻击,而是专注于由协同感知带来的新漏洞。此外,攻击者不能破解密码保护,因此无法威胁车辆之间的安全通信通道。

C. 攻击限制

(1)传感器物理和定义范围:要求攻击者遵守有关数据格式的基本规则,否则检测异常将很困难。攻击者的LiDAR点云应具有合理的点密度分布,激光器的角度应符合LiDAR配置。此外,点云必须呈现出合理的遮挡效果,以规遍基于遮挡特征的异常检测方法。攻击者共享的中间特征应在定义范围内,避免出现过于离谱的值。

(2)定向攻击:攻击者应能够指定用于欺骗或移除攻击的目标区域,以支持对危险场景的精心创建。否则,不定向和不可控的攻击影响将损害攻击的有效性和隐蔽性。

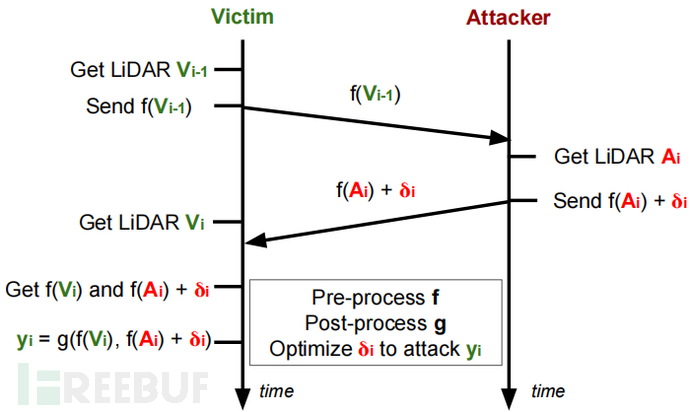

(3)实时时间约束:协同感知是一个异步的多主体系统,每辆车都在周期内生成LiDAR图像,但在时间上不同步。上图显示了协同感知中事

畅读付费文章

如需授权、对文章有疑问或需删除稿件,请联系 FreeBuf 客服小蜜蜂(微信:freebee1024)

本文由

本文由